Multi-scale features fusion from sparse LiDAR data and single image for depth completion (ELECTRONICS LETTERS 2018)

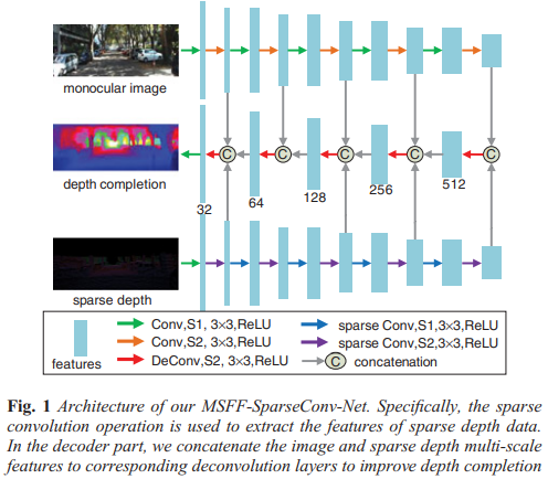

这篇文章的目标是利用一张单目图像和一张稀疏的深度图进行深度补全,文中采用一种多尺度融合的方式来学习两种不同数据的关联性,并引入稀疏卷积操作来增强稀疏深度图中特征的鲁棒性。网络结构如下:

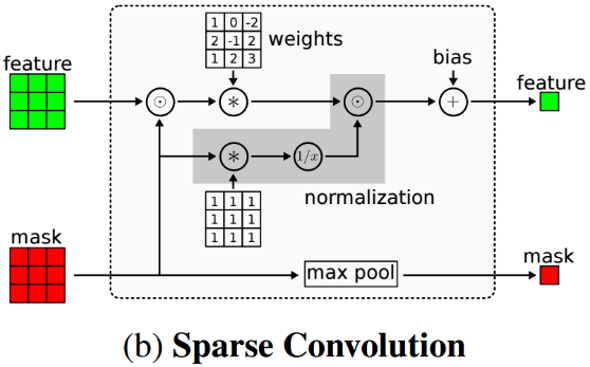

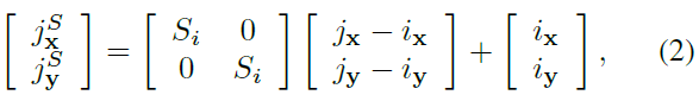

稀疏卷积的实现方式:

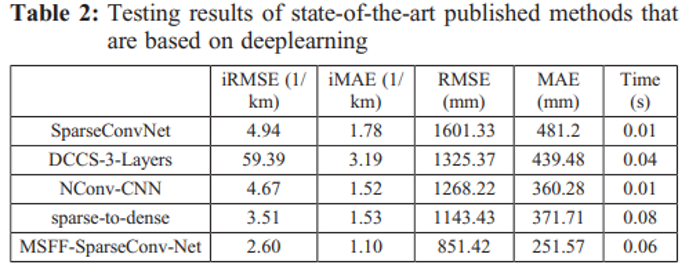

部分实验结果如下:

DFuseNet: Deep Fusion of RGB and Sparse Depth Information for Image Guided Dense Depth Completion (ITSC2019国际交通系统会议)

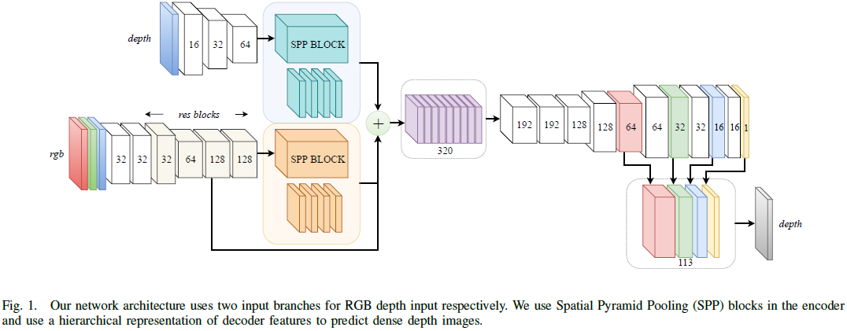

本文的目标:设计一个CNN,能从RGB图像中学到足够多的全局和上下文信息,并用这些信息和稀疏深度输入来精确预测整个图像的深度估计,同时加强边缘保持和平滑约束。值得借鉴的是,这篇论文中,它把RGB图和深度图先经过两个不同的网络分别提取特征,并利用金字塔池化有效地学习局部到全局的特征,然后再进行融合,最后利用一个decoder来重建出稠密的深度图,网络结构如下:

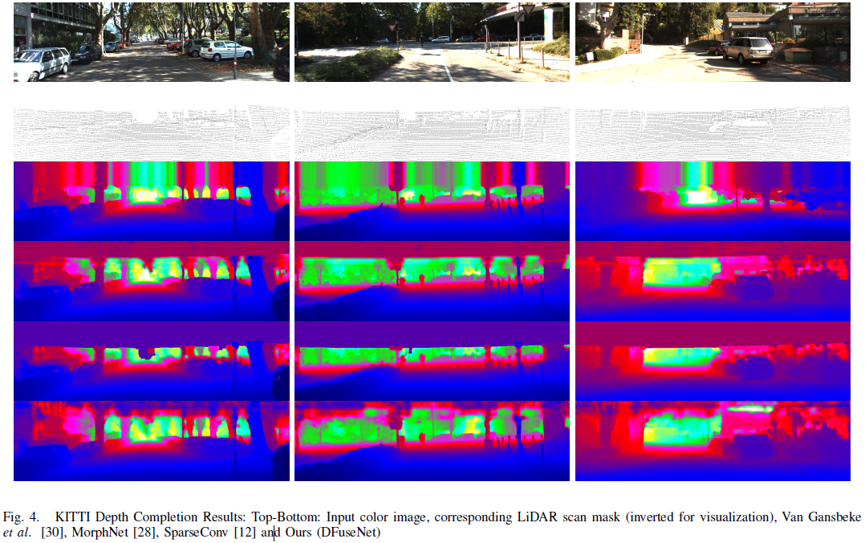

给出部分实验结果:

LAF-Net: Locally Adaptive Fusion Networks for Stereo Confidence Estimation(CVPR2019)

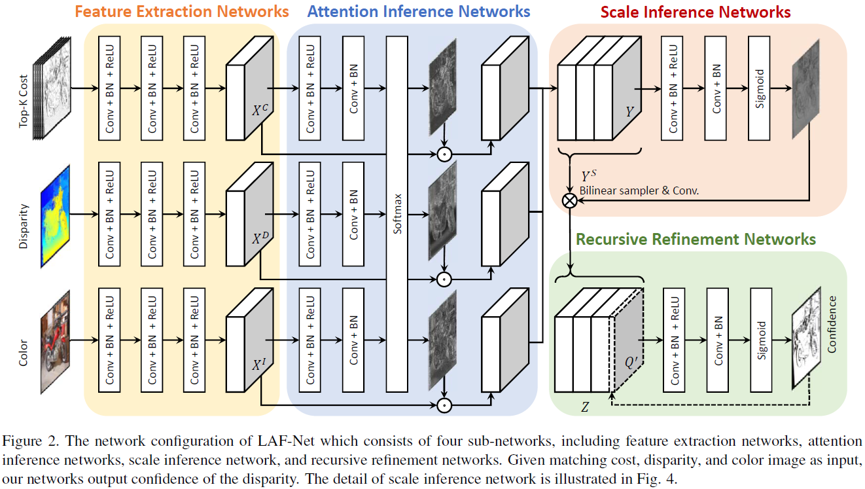

本文提出了一种利用深度网络的三模态输入,包括匹配代价、视差和彩色图像来估计初始视差置信度的方法。采用局部自适应的融合网络学习局部变化的attention和scale map用于融合三模态的置信特征。网络结构如下:

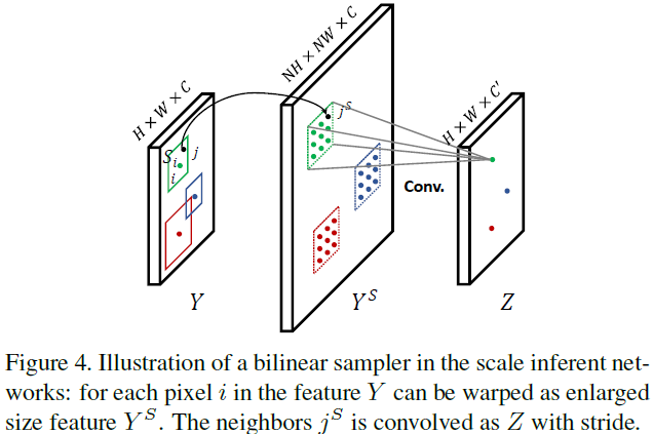

该网络主要包含四个子网络,首先是特征提取网络,主要用于学习得到三模态输入的非均匀特征;注意力推理网络对三模态置信特征的重要性进行编码,利用注意力map自适应地融合这些不同特征;尺度推理网络用于学习针对所有像素的局部自适应的尺度参数,使得网络可以利用局部最优的感受野来提取置信特征,具体如下图;第四部分为递归的精细网络,采用迭代的方式来细化置信特征,以增强空间纹理和局部一致性。

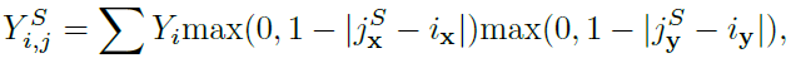

其中,局部变化的采样网格定义为:

卷积层的感受野通过Bilinear 采样器warped得到,定义如下:

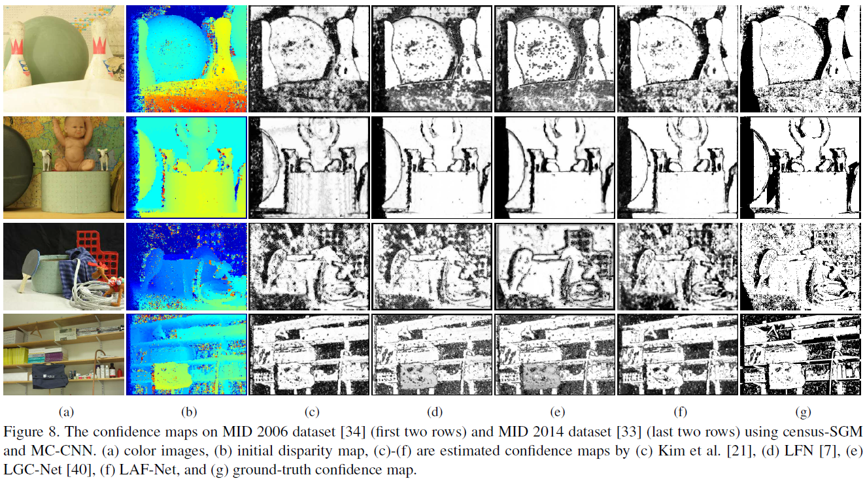

给出一部分实验结果: